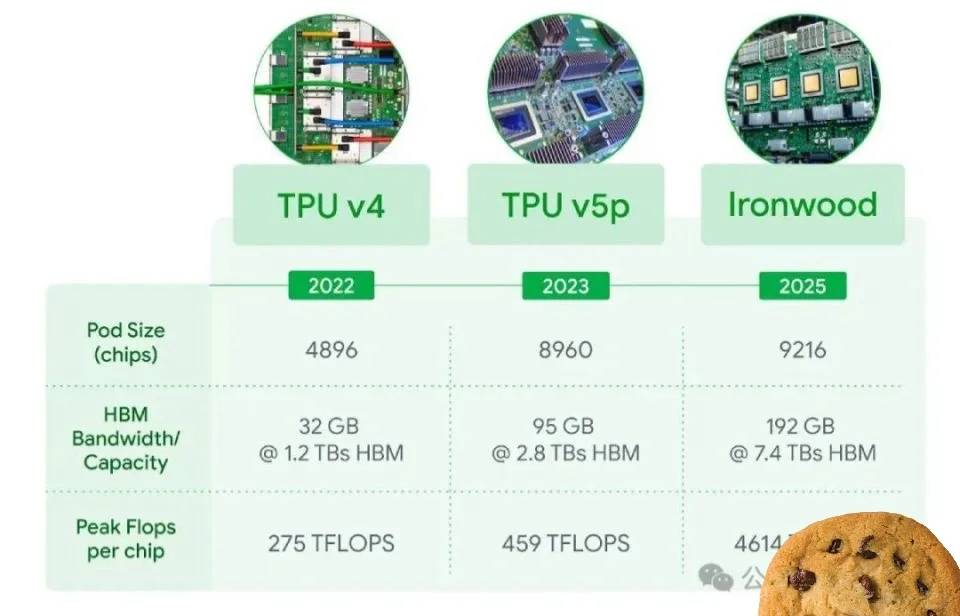

1. A Google acaba de revelar seu revolucionário processador TPU de 7ª geração, Ironwood – uma potência projetada especificamente para trabalhos de IA, com uma impressionante capacidade de computação de pico de 4.614 TFLOPs por chip.

2. Marcando um grande avanço, o Ironwood se torna o primeiro TPU da Google a superar limitações anteriores ao suportar cálculos em FP8, expandindo-se além dos formatos INT8 e BF16 das gerações anteriores.

3. A inovação continua com a integração do acelerador SparseCore de terceira geração de ponta no Ironwood, fazendo sua estreia após aparecer pela primeira vez na série TPU v5p.

4. A conectividade também recebe uma gigantesca atualização – a largura de banda de interconexão entre chips do Ironwood melhora drasticamente, com velocidades de transmissão bidirecional disparando para 1,2 Tbps, entregando 1,5 vezes mais throughput que seu antecessor Trillium.

5. Por meio de melhorias abrangentes nos núcleos de computação, HBM e outros componentes críticos, o Ironwood atinge um impressionante marco: dobrando a eficiência de desempenho-por-watt em comparação com o Trillium.

Essa potência de processamento é impressionante! O suporte para FP8 deve abrir novas possibilidades em machine learning, especialmente para aplicações mais complexas e eficientes. Já estou curioso pra ver como isso vai impactar o desenvolvimento de modelos em tempo real.