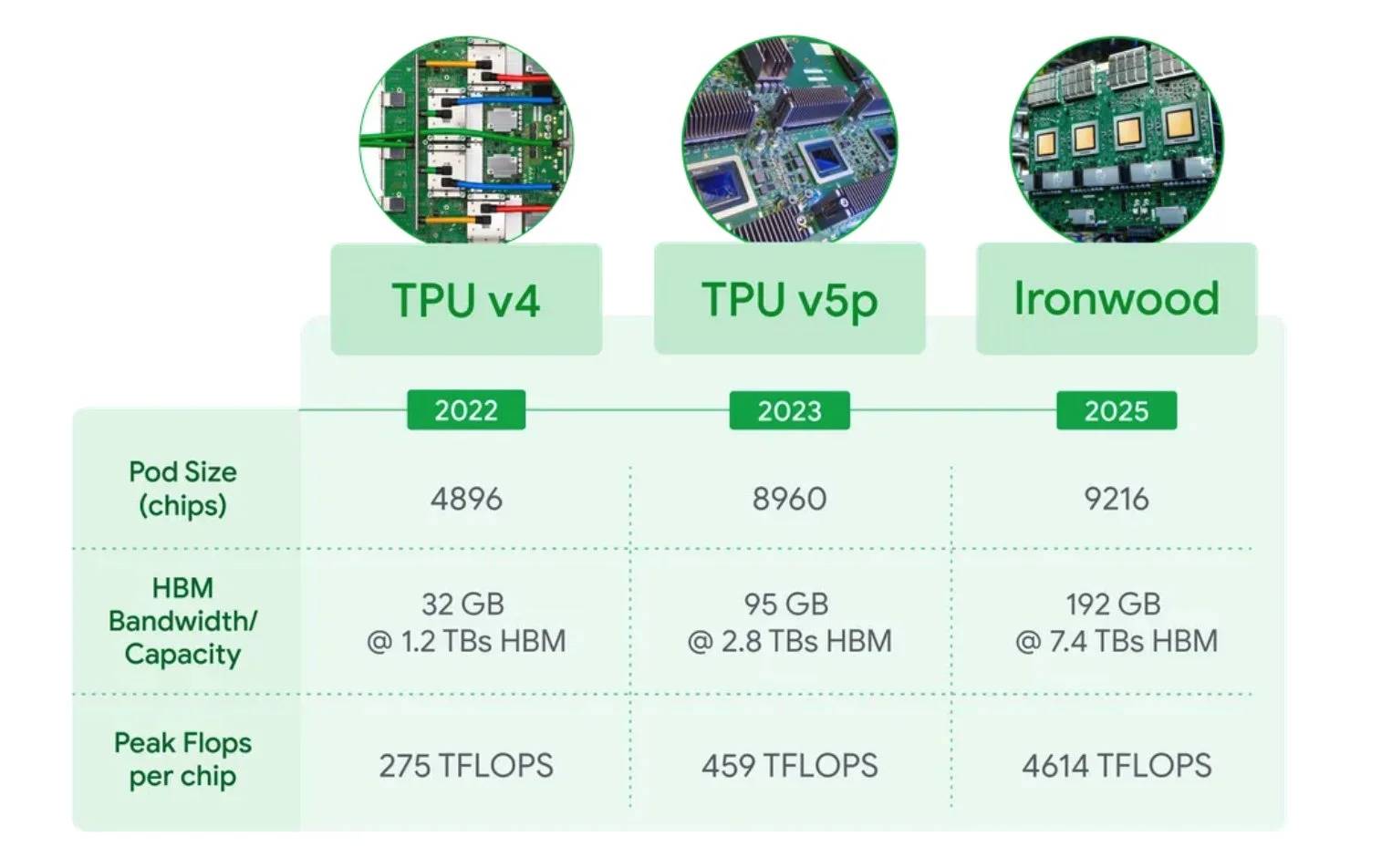

🌟 Google frappe encore ! Lors de la conférence Google Cloud Next 2025, Google a dévoilé sa septième génération de TPU—Ironwood, spécifiquement conçue pour les tâches d'inférence IA, et ses performances sont absolument époustouflantes ! À quel point cette mise à jour est-elle dingue ? Plongeons-y ! ⸻ 🎯 À quel point Ironwood est-il puissant ? • **Performance par puce** La puissance de calcul atteint un impressionnant 4 614 TFLOPs (10 fois plus rapide que le TPU v5p !)

, propulsant les vitesses d'inférence IA à des sommets inédits 🚀 • **Mémoire massive** Chaque puce dispose de 192 Go de HBM avec une bande passante de 7,4 Tbps— 6 fois plus de mémoire et 4,5 fois plus de bande passante que la génération précédente, gérant facilement les grandes quantités de données ! • **Super-cluster** Un seul Pod contient 9 216 puces, offrant une puissance de calcul totale de 42,5 exaflops— 24 fois plus puissant que le superordinateur le plus puissant du monde ! • **Double l'efficacité énergétique** 2 fois plus économe en énergie que Trillium et 30 fois meilleure que le TPU v2 ! Économiser de l'énergie tout en étant écologique !

🧠 Conçu pour « penser » IA Ironwood est le premier TPU de Google spécifiquement conçu pour l'inférence IA, parfait pour exécuter des IA « intelligentes » comme les modèles de langues massives (LLMs) et les modèles mixtes d'experts (MoE). Les modèles avancés comme Gemini 2.5 et AlphaFold verront des améliorations massives en termes de vitesse d'inférence et de coût !

⸻ ⚡ Principales mises à jour • **Interconnexion ultra-rapide** Les vitesses de communication entre puces atteignent 1,2 Tbps, permettant une collaboration fluide entre plusieurs puces ! • **Refroidissement liquide** Prend en charge le fonctionnement stable de clusters de 9 216 puces sans limitation thermique ! • **Boost logiciel** Alimenté par le système Pathways de Google, gérant sans effort des dizaines de milliers de puces—l'expérience développeur au meilleur de son potentiel !

⸻ 🌐 Google contre Nvidia ? Avec Ironwood, Google double la pression dans la course aux matériels IA, challengant directement les GPU Blackwell B200 de Nvidia ! Google a également annoncé le support vLLM, permettant aux tâches PyTorch optimisées pour GPU de s'exécuter sans problème sur les TPUs—un rapport coût-performance imbattable !

⸻ 📅 Quand pourrez-vous l'utiliser ? Ironwood devrait être lancé fin 2025, avec les utilisateurs de Google Cloud ayant accès en priorité ! Il sera également intégré à l'Hypercomputer IA de Google—le printemps arrive pour les développeurs IA !

⸻ 💬 Le Ironwood de Google est sérieusement de niveau supérieur ! Croyez-vous que Google peut vaincre Nvidia cette fois-ci ? Laissez vos réflexions dans les commentaires ! 👇

Comments are closed.